美团发布开源项目LongCat-Flash-Omni

美团正式发布并开源了其名为LongCat-Flash-Omni的项目,该项目旨在提供一套高性能、可扩展的Flash存储解决方案,旨在满足日益增长的数据存储需求,通过开源的方式,LongCat-Flash-Omni将促进业界的技术交流与合作,共同推动Flash存储技术的发展和应用,此举有助于提升行业整体的技术创新能力和竞争力,为未来的数字化世界打下坚实基础。

美团宣布 longcat-flash 系列模型迎来新突破,正式推出全新成员——longcat-flash-omni。

据悉,LongCat-Flash-Omni 是业内首个集“全模态覆盖、端到端架构、大参数量高效推理”于一身的开源大语言模型。该模型首次在开源领域实现了多模态能力与闭源模型的全面对标,依托创新的架构设计与深度工程优化,使具备大规模参数的模型在处理多模态任务时仍可实现毫秒级响应,有效攻克了行业长期面临的高延迟推理难题。

基于 LongCat-Flash 系列原有的高效结构(Shortcut-Connected MoE,含零计算专家),LongCat-Flash-Omni 进一步融合了高效的多模态感知模块和语音重建技术。即便总参数高达5600亿(激活参数为270亿),依然能够支持低延迟的实时音视频交互,为开发者在复杂多模态场景下的应用落地提供了更加强大且高效的解决方案。

综合评测显示,LongCat-Flash-Omni 在多项全模态基准测试中达到开源模型中的最先进水平(SOTA),并在文本理解、图像识别、视频分析以及语音感知与生成等单项任务中表现出卓越性能,竞争力显著。

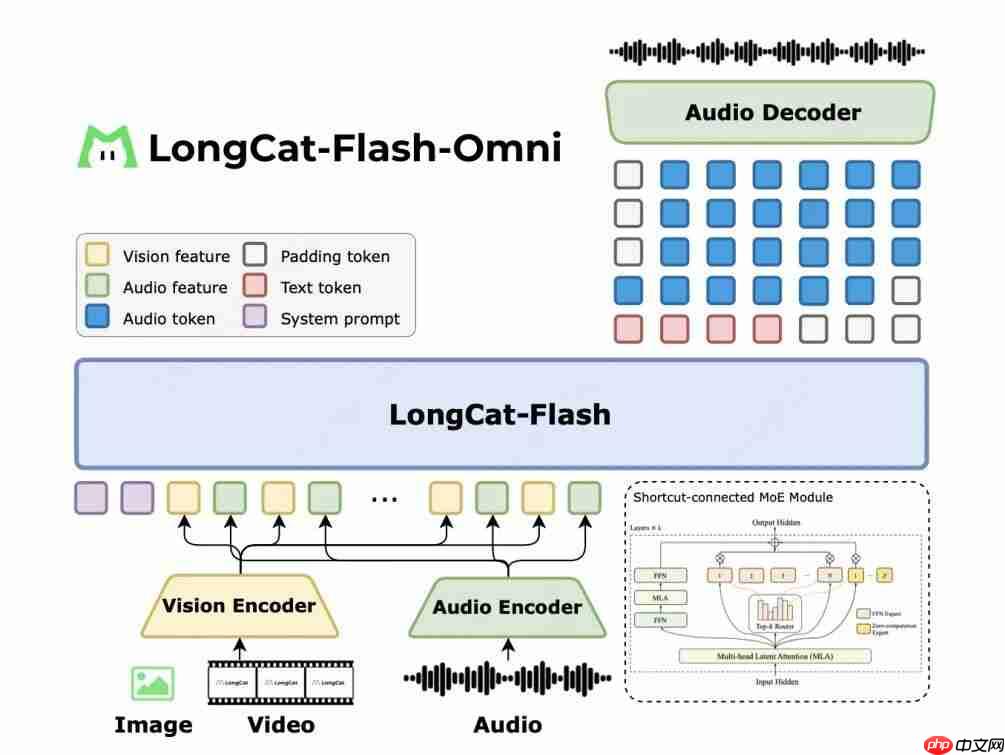

作为一款追求极致性能的开源全模态模型,LongCat-Flash-Omni 在统一框架下整合了离线多模态理解与实时音视频交互能力。其采用完全端到端的架构设计,以轻量级视觉与音频编码器作为输入感知模块,由大语言模型直接处理原始输入并生成文本与语音 token,再通过轻量化音频解码器还原为自然语音波形,从而实现流畅、低延时的实时对话体验。

所有核心组件均针对流式推理进行了高度优化:视觉编码器与音频编解码器均为约6亿参数的小型化设计,延续了 LongCat-Flash 系列一贯的高效理念,在保证强大性能的同时实现了推理效率的最大化,达成了性能与成本之间的理想平衡。

LongCat-Flash-Omni 的整体模型架构如下所示:

Hugging Face:https://www.php.cn/link/2ae659bde981b0ad9c0f24835a8d1232

Github:https://www.php.cn/link/f1cc3b90f5460d50d5200128a455979d

下一篇 >>

网友留言(0 条)