微软突破数据中心芯片散热难题,微流体结合AI技术实现精准降温

微软成功解决数据中心芯片散热难题,采用微流体技术和人工智能算法实现精准降温,这一创新方法能有效提高数据中心运行效率和稳定性,降低能耗和成本,微流体技术结合AI算法,可智能调节芯片温度,确保数据中心在高负载下仍能保持良好性能,这一突破有助于推动数据中心技术的发展,为云计算和大数据处理提供更强大的支持。

感谢网友 snailwang 提供的线索!

9 月 24 日讯,微软于昨日(9 月 23 日)发布技术博客,宣布在 AI 芯片散热领域取得重大突破——成功研发出“芯内微流体冷却系统”,其散热效率最高可达当前主流冷板技术的三倍。

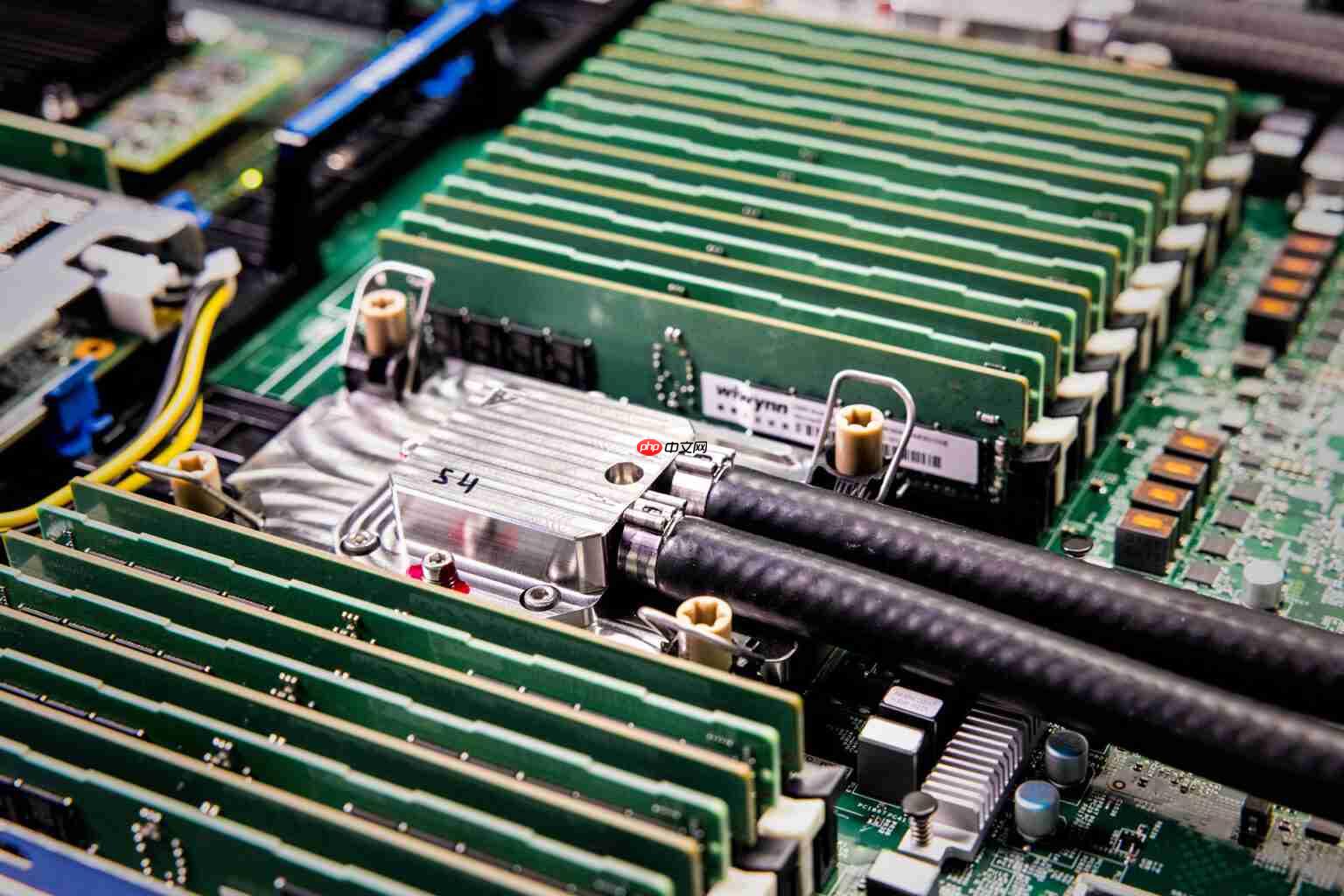

注:冷板属于传统液冷方案,通过将带有液体通道的金属板贴合在芯片表面进行导热。但由于需经过封装层、焊料层等多重材料,热量传导受到显著限制。

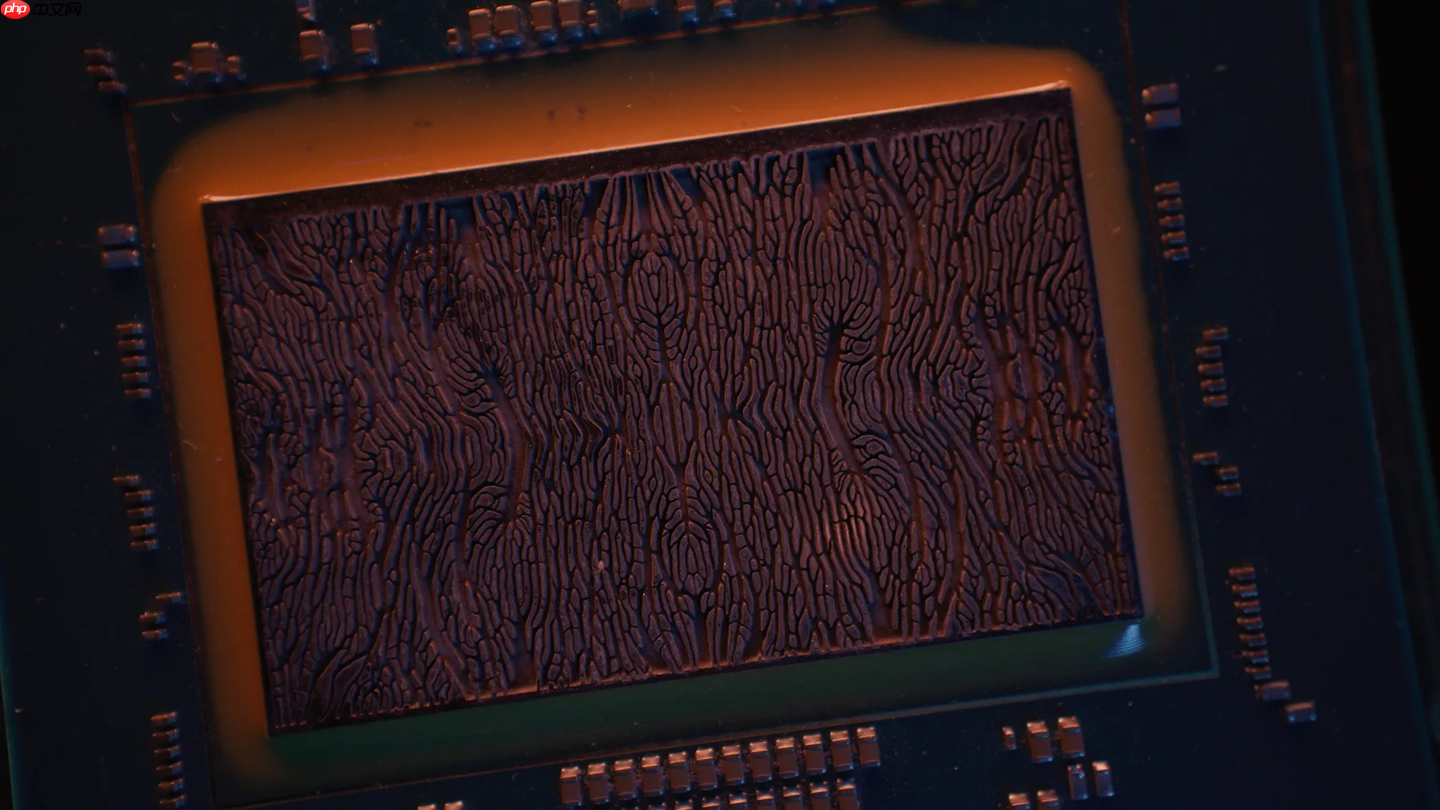

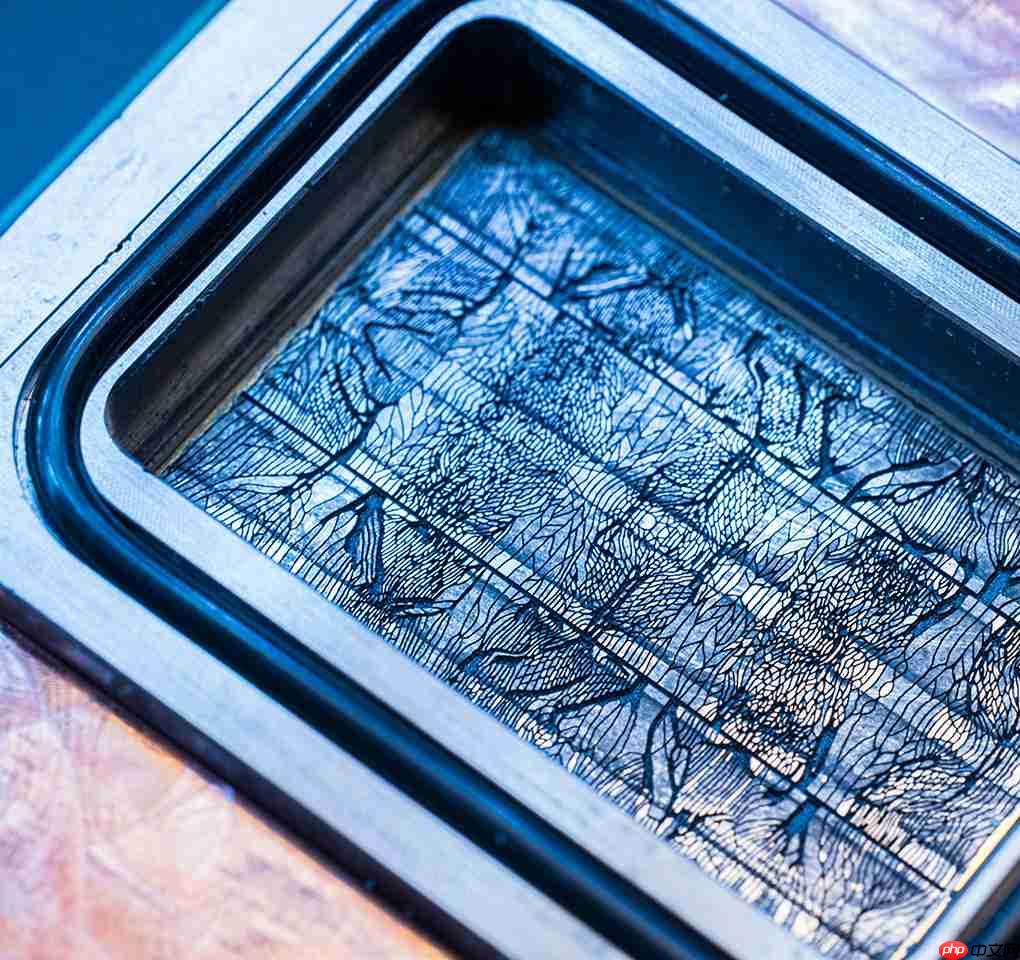

相比之下,芯内微流体冷却技术则彻底摒弃这些“中间隔热层”,将冷却液直接引入硅芯片内部,使其与发热源近距离接触,并借助 AI 实现对冷却路径的智能调控,真正实现从源头控温。

研究团队利用 AI 模型分析芯片运行时的动态热图谱,精准引导冷却液流向温度最高的区域。实测结果显示,在多种负载条件下,该技术可使 GPU 芯片的最大温升降低达 65%,同时显著优化数据中心的整体能效比(PUE)。这不仅大幅减少了冷却系统的能耗,也减轻了对电力基础设施的压力,推动数据中心向更高可持续性迈进。

在测试中,微软模拟了实际运行 Microsoft Teams 视频会议服务的服务器场景,验证了该技术在高并发和突发任务下的出色温控表现。这意味着未来数据中心可在确保安全的前提下对芯片进行超频操作,从而提升计算性能和响应可靠性,同时避免为应对短时峰值而部署大量冗余硬件,有效节约成本。

然而,这项技术的大规模应用仍面临多项工程难题。其中最大的挑战在于如何在不损害硅基结构强度的前提下,制造出兼具高流量与高精度的微流道系统。此外,还包括防止液体泄漏的封装工艺、冷却介质配方的持续优化,以及与现有芯片制造流程的兼容集成等问题,尚需进一步攻关。

下一篇 >>

网友留言(0 条)