字节跳动与清华大学联合开源统一多模态框架HuMo,引领AI新纪元

字节跳动联合清华大学推出开源统一多模态框架HuMo,这一框架旨在支持多种模态的数据融合和处理,包括文本、语音、图像和视频等,HuMo框架具备高度灵活性和可扩展性,能够助力人工智能研究和应用的发展,该框架的开源性质将促进技术共享和创新,推动多模态技术在各行各业的广泛应用,这一合作展示了科技与学术界的紧密合作,对于推动人工智能领域的发展具有重要意义。

论文地址: https://www.php.cn/link/5810733635b8629df4a4badaaef78f6c

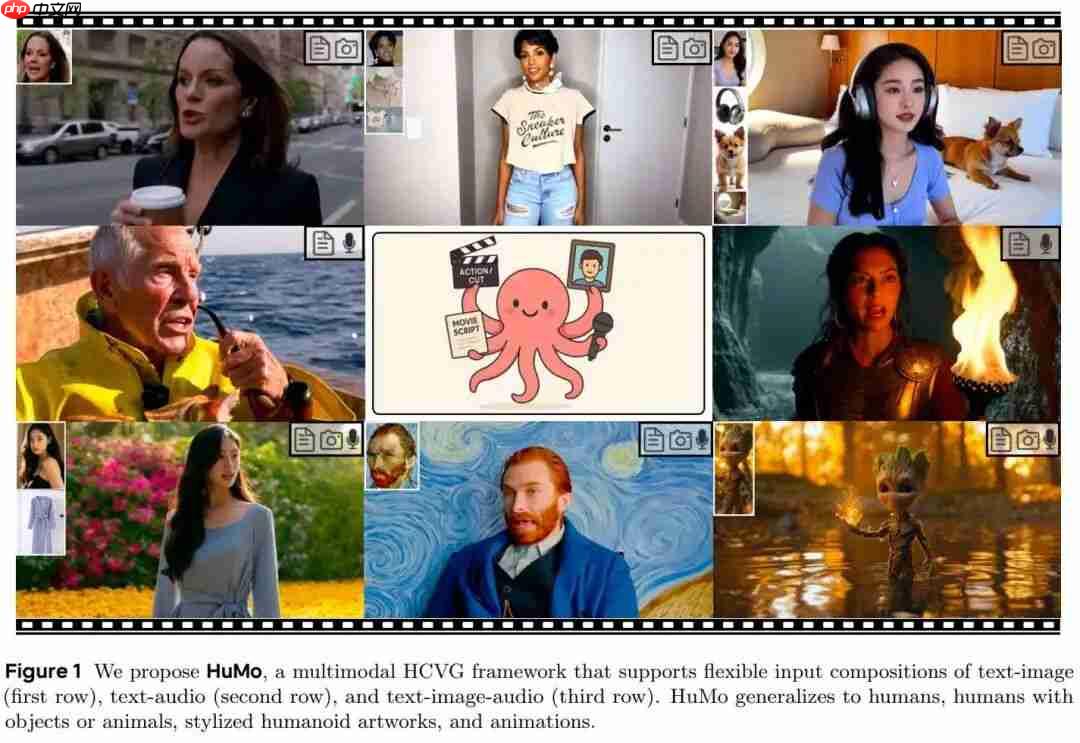

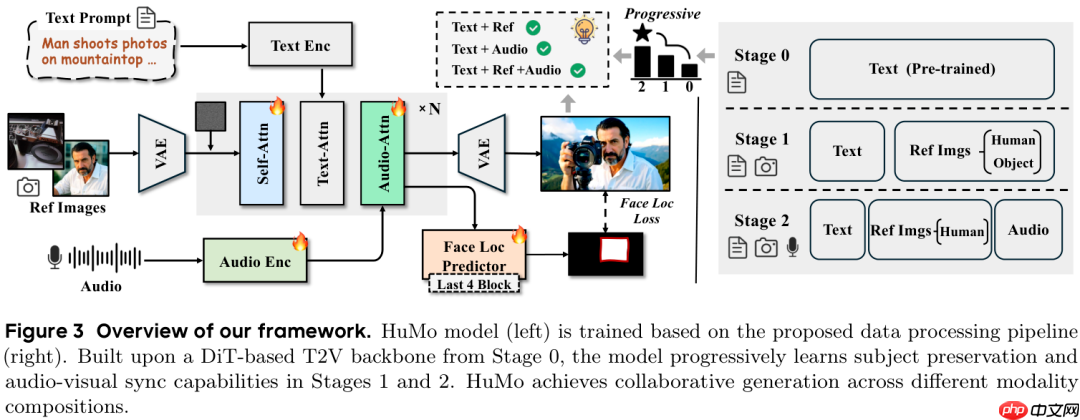

由字节跳动智能创作团队与清华大学联合推出的 HuMo,是一个统一的 HCVG(Human-Centric Video Generation)框架,致力于推动以人为中心的视频生成技术发展。该框架支持文本、图像和音频三种模态的协同驱动,实现高度可控的人物视频生成。

HuMo(全称 Human-Modal)通过构建高质量多模态数据集,并引入创新的渐进式训练机制,首次在统一模型中实现了对多种输入信号的有效融合与精细控制。其生成视频最高可达 720P 分辨率,最长支持 97 帧、25FPS 的输出,在多个子任务上的表现均超越当前专用模型。

该框架的关键技术包括全新的数据处理流程、逐步增强的多模态训练策略,以及可根据输入灵活调整的推理机制。

项目地址:

https://www.php.cn/link/09604c68bfa72e9930b00c967e64747e

https://www.php.cn/link/b2a242690f117309099b7a561b605e9e

<< 上一篇

网友留言(0 条)